LiDAR II

Sicherer Flughafenvorfeldbetrieb mittels automatisierter Gefahrenerkennung unter Verwendung eines (wetter-)robusten LiDAR (Light Detection And Ranging)-Objekterkennungssystems.

Projektinformation

- Auftraggeber: DFG - Deutsche Forschungsgemeinschaft

- Laufzeit: Juli 2018 - März 2022

- Folgeprojekt des DFG-geförderten Projektes LiDAR I (FR 2440/4-1)

In den letzten Jahrzehnten hat sich der Grad der Automatisierung bei der Luftraumüberwachung und -kontrolle sowohl bord- als auch bodenseitig stetig erhöht (z.B. Airborne Collision Avoidance Systeme). Ausgenommen der bisher nur an wenigen großen Flughäfen vollausgebauten, multisensoriellen Advanced - Surface Movement Guidance and Control System (A-SMGCS) Systeme ist der gegenwärtige Automatisierungsgrad bei der Vorfeldkontrolle weiterhin vergleichsweise gering. Die Ursachen hierfür sind zum einen in der systemimmanenten Komplexität und Vielfalt von Objekten und Prozessen auf dem Vorfeld zu suchen, welche eine (automatisierte) Überwachung dieser Flächen selbst mit A-SMGCS Unterstützung grundsätzlich erschweren. Zum anderen kann ein Automat nur dann eine ihm übertragene Überwachungs- und Kontrollaufgabe effektiv ausführen, wenn die Güte der Eingangsinformationen adäquat ist, was jedoch mithilfe herkömmlicher Sensorik bisher nicht sichergestellt werden kann. Im Lichte der SESAR Forderung nach erhöhter Automatisierung im ATM System und zunehmend leistungsfähigeren Sensorsystemen zeigt die Vorfeldkontrolle Potenzial für erhöhte betriebliche Sicherheit. Automatisierte Assistenzfunktionen zur interessensrelevanten Informationsvisualisierung, Aufmerksamkeitslenkung und Alarmierung, Prädiktion zukünftiger Konflikte sowie Entscheidungsunterstützung bei der Konflikterkennung und -lösung können realisiert werden. Durch diese Funktionen ist, mit Blick auf die menschliche Informationsverarbeitung, eine Reduktion der kognitiven Komplexität der Lotsentätigkeit, mit verbesserter Aufgabenpriorisierung und -ausführung, bei gleichzeitig reduzierter Arbeitsbelastung, zu erwarten.

Im Folgeprojekt LiDAR II sollen Grundlagen und Techniken zur automatischen Interpretation komplexer dynamischer Vorfeldszenen in LiDAR-Daten unter schwierigen Wetterlagen geschaffen werden, die über die bisherige Objektdetektion, -klassifikation, -instanzerkennung und -verfolgung hinausgehen und nunmehr auch Objektinteraktionen analysieren können. Anknüpfend an die bisherige Forschungsarbeit soll die Risikominderung nun primär über die maschinelle Unterstützung des Vorfeldlotsen bei der bisher ausschließlich kognitiv erbrachten Erkennung von potentiellen Gefahrensituationen in Vorfeldszenen anhand gefahrentypischer visueller Merkmale erfolgen, so dass Gefahrensituationen automatisiert zur Anzeige gebracht werden können.

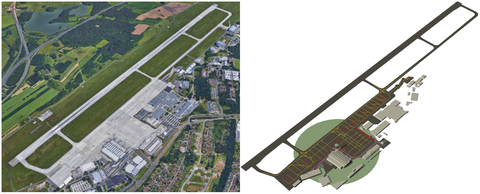

Modernste Algorithmen der semantischen LiDAR-Segmentierung stützen sich auf große Trainingsdatensätze mit akkuraten Labelinformationen. Obwohl einige händisch erzeugte Datensätze öffentlich verfügbar sind, erfordert die punktweise Annotation von 3D-Punktwolken extrem mühsame Arbeit. Daher entwickelten wir einen simulationsbasierten Ansatz zur Erzeugung synthetischer Trainingsdaten des Flughafenvorfelds unter Verwendung einer virtuellen Flughafenumgebung und eines integrierten LiDAR-Sensormodells. Die genaue, maßstabsgetreue 3D-Modellierung der Flughafenumgebung ist ein wichtiger Baustein zur Simulation eines realistischen Vorfeldbetriebs. Zu diesem Zweck erstellen wir ein detailiertes 3D-Modell des Flughafens Dresden mit Hilfe von Computer-Aided Design (CAD)-Software.

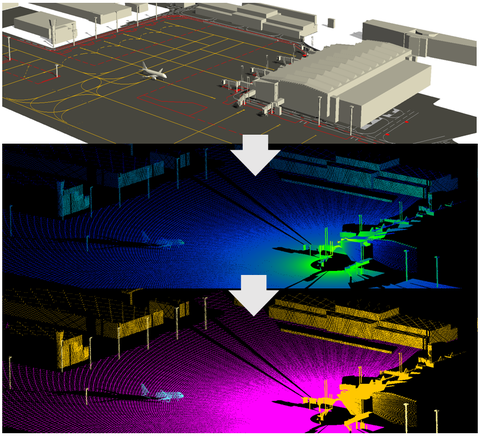

Mithilfe der entwickelten Simulationsumgebung können beliebige Szenarien gebildet werden, die unter verschiedenen Betriebsbedingungen, einschließlich statischer Objekte und sich bewegender Objekte (Luftfahrzeuge1) und Bodenfahrzeuge1)) realitätsnahe LiDAR Punktwolken sowie Labelinformationen liefern. Auf diese Weise trainierten und testeten wir erfolgreich ein semantisches LiDAR-Segmentierungsmodell das in der Lage ist zuverlässig Luftfahrzeugtypen und deren Bewegungsrichtung zu unterscheiden sowie dünne Strukturen (Masten), Flughafengebäude und die Bodenebene automatisch zu erkennen. Die entwickelte Technik stellt eine wichtige Grundlage für die erwartete Leistung des trainierten Modells auf realen Daten dar. Wir glauben, dass das resultierende Framework zusätzliche visuelle Hinweise zur Erfassung relevanter semantischer Informationen liefert, die den Lotsen in komplexen Situationen potenziell unterstützen.

Die modular aufgebaute Simulationsumgebung integriert ein LiDAR-Sensormodell des am Flughafen Dresden installierten Sensors, physikalische Eigenschaften der Umgebung, detaillierte 3D-Modelle der Szene sowie kinematische Modelle dynamischer Objekte. Es eignet sich dazu weitere Sensortypen zu integrieren und bietet die Möglichkeit optimale Sensorpositionen am Flughafen zu identifizieren.

Die Simulationsumgebung ist in der Lage große Mengen an Trainingsdaten (Simulierte LiDAR Punktwolken sowie zugehörige Labelinformationen) statischer und dynamischer Szenen am Flughafen automatisiert zu generieren. Die hierbei gewonnen Daten können dazu verwendet werden Systeme anzutrainieren, die es zukünftig ermöglichen auch nichtkooperative Objekte am Flughafen automatisiert zu erkennen, deren Bewegungen zu analysieren und automatisiert potentielle gefährliche Situationen zu erkennen und zu prognostizieren.

1) Moveable 3D models were kindly provided by TRANSOFT Solutions

Die semantische Segmentierung von LiDAR Punktwolken ist ein wichtiges Forschungsgebiet der Bildverarbeitung und des maschinellen Lernens. In der Zwischenzeit existiert eine Vielzahl effizienter Algorithmen für die Lösung dieser Aufgabe mittels Deep Learning. Eines der genauesten und schnellsten Verfahren für die semantische Segmentierung von LiDAR-Punktewolken ist RangeNet++ [1] (Stand: 2019), da es die meisten existierenden Methoden für diese Aufgabe in Bezug auf Genauigkeit und Rechenzeit für die Inferenz übertrifft. Die Darstellungsmöglichkeiten des gewählten Verfahrens sind besonders wichtig, um kleine, dünne Strukturen (z.B. Masten), subtile Formunterschiede (z.B. zwischen verschiedenen Flugzeugtypen) und die beabsichtigte Bewegungsrichtung von Flugzeugen und anderen beweglichen Objekten auflösen zu können. Eine umfassende Übersicht der aktuell besten Verfahren für die semantische Segmentierung von LiDAR-Punkwolken ist beispielsweise in [2, 3] zu finden.

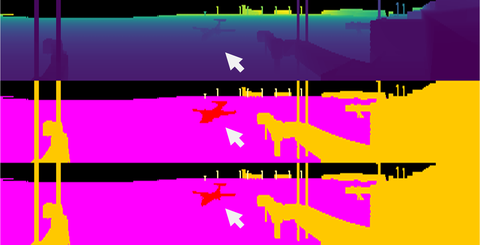

Im Speziellen wandelt RangeNet++ Eingabepunktwolken in sphärische Tiefenbilder um, die von einem 2D-CNN unter Verwendung planarer Faltungen verarbeitet werden. Die resultierenden pixelweisen Label werden auf die 3D-Punktewolke projiziert, gefolgt von einem schnellen k-Nearest-Neighbor-basierten Korrekturschritt, der mögliche Inkonsistenzen der Label in 3D auflöst.

In der simulierten Umgebung sind wir mit einem einzelnen LiDAR-Sensor, der bereits einen großen Teil der Flughafeninfrastruktur einschließlich des Vorfelds abdeckt, in der Lage, Objekte zuverlässig zu erkennen und zu segmentieren. Insbesondere bei bewegten Objekten, die einer kurzen Haltezeit unterliegen, konnte das Segmentierungsmodell die feingranulare semantische Unterscheidung zwischen Objektinstanzen (A320, Q400) und ihrer beabsichtigten Bewegungsrichtungen konsistent erfassen. Das trainierte Segmentierungsmodell war auch in der Lage, statische Objekte der Flughafeninfrastruktur mit nahezu 100%iger Genauigkeit unter Verwendung beliebiger Sampling-Raten des LiDAR Sensors zu erkennen.

Darüber hinaus beträgt selbst unter Verwendung unserer nicht optimalen Hardware die Inferenzzeit des semantischen Segmentierungsmodells weniger als 2 s für große Punktwolken mit über 6 Millionen Punkten. In unseren Experimenten konnten wir auch feststellen, dass das Segmentierungsmodell immer in der Lage war, Flugzeuginstanzen konsistent zu erkennen.

Unsere experimentelle Auswertung deutet darauf hin, dass die Erzeugung von synthetischen LiDAR-Daten sowie das Training des semantischen Segmentierungsmodells sehr gut funktionieren und sich leicht auf beliebige Flughäfen übertragen lassen. Das vorgeschlagene Rahmenwerk zur semantischen Segmentierung leistet einen wichtigen Beitrag zur Überwachung, da es die ATCo potenziell mit zusätzlichen visuellen Hinweisen zur Erfassung der lokalen Verkehrssituation unterstützt.

Unser Segmentierungsverfahren bietet auch die Grundlage für die Implementierung automatisierter Funktionen, die den Flughafenbetrieb sicherer machen, z.B. die rechtzeitige Erkennung potenzieller Konflikte und Zwischenfälle zwischen beweglichen Objekten, die Erkennung von FOD, Geschwindigkeitsüberwachung sowie Runway Monitoring and Conflict Alerting (RMCA).

Außerdem möchten wir erwähnen, dass es im Allgemeinen möglich ist, aus einer beschrifteten Punktwolke betriebsrelevante Informationen abzuleiten, einschließlich AOBT, AIBT, ATOT und ALDT.

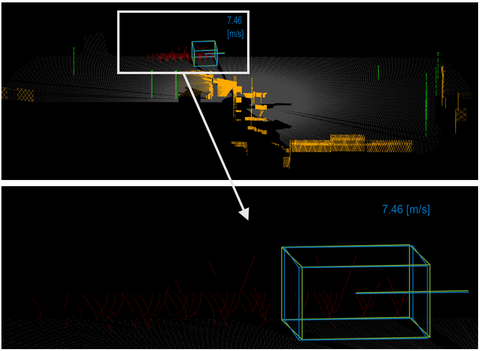

Darüber hinaus haben wir mit Hilfe unserer virtuellen Flughafenumgebung ein Verfahren zur Erkennung und Verfolgung von sich schnell bewegenden, nicht kooperativen Objekten in semantischen LiDAR-Punkwolken entwickelt. Unsere Methode integriert eine neuartige Sampling-Strategie in Verbindung mit einem Kalman-Filter, der das Abtastprinzip des LiDAR-Sensors ausnutzt, um Punkte aus verzerrten Punktmengen in Abhängigkeit von der Geschwindigkeit des abgetasteten Objekts und seiner Entfernung zum Sensor auszuwählen. Experimentelle Ergebnisse an simulierten Daten zeigen, dass die von uns vorgeschlagene Strategie auch bei Verwendung nur eines Sensors und zusätzlich auch bei nicht kooperativen Objekten, Ergebnisse innerhalb oder nahe der durch die A-SMGCS-Anforderungen festgelegten Grenzen für Positions- und Geschwindigkeitsmessung erzeugen. Einschränkungen des Ansatzes ergeben sich hauptsächlich aus Selbstverdeckungen der vom Sensor erfassten Oberflächen, die wir in unserer zukünftigen Arbeit angehen wollen, z.B. durch die Integration mehrerer LiDAR-Sensoren in die Flughafenumgebung.

[1] A. Milioto and I. Vizzo and J. Behley and C. Stachniss, RangeNet++: Fast and Accurate LiDAR Semantic Segmentation, IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS) 2019

[2] J. Behley and M. Garbade and A. Milioto and J. Quenzel and S. Behnke and C. Stachniss and J. Gall, SemanticKITTI: A Dataset for Semantic Scene Understanding of LiDAR Sequences, in Proc. of the IEEE/CVF International Conf.~on Computer Vision (2019)

[3] A. Geiger and P. Lenz and R. Urtasun, Are we ready for Autonomous Driving? The KITTI Vision Benchmark Suite, in Proc.~of the IEEE Conf.~on Computer Vision and Pattern Recognition (CVPR) (2012)

Im Rahmen des Projektes wurden folgende Forschungsergebnisse publiziert:

- Johannes Mund, Alexander Zouhar and Hartmut Fricke (2018): Performance Analysis of a LiDAR System for Comprehensive Airport Ground Surveillance under Varying Weather and Lighting Conditions (ICRAT 2018), Barcelona, Spain

- Hannes Brassel, Alexander Zouhar and Hartmut Fricke (2019): Validating LiDAR vs. Conventional OTWV/CCTV surveillance technology for safety critical airport operations (SID 2019), Athens, Greece

- Hannes Brassel, Alexander Zouhar and Hartmut Fricke (2020): 3D modeling of the airport environment for fast and accurate LiDAR Semantic Segmentation of Apron Operations (DASC 2020), San Antonio (virtual conference), Texas, US

- Hannes Brassel, Alexander Zouhar and Hartmut Fricke (2020): Adaptive point sampling for LiDAR-based detection and tracking of fast-moving vehicles using a virtual airport environment (SID 2020), virtual conference

Fetiggestellte Arbeiten:

- DA (2019): Leistungsanalyse zur Objekterkennung mittels LiDAR Sensoren im Vergleich zu konventionellen Technologien und dem menschlichen Sehvermögen

- FP (2019): Entwicklung eines Modells zur Prognose von Flugzeugrollbewegungen auf dem Flughafenvorfeld

- StA (2019): Spezifikation visueller Verhaltens- und Gefahrenmuster für ein automatisiertes LiDAR Gefahrenanalysemodell am Flughafen Dresden

- FP (2020): Pose estimation and tracking of taxiing aircraft in labelled LiDAR point clouds of the airport apron

- MA (2020): Quantitative Bewegungsprognose dynamischer Objekte am Flughafen mithilfe regelbasierter Prognoseverfahren

-

DA (2020): Entwicklung eines Niederschlagsmodells für die LiDAR Simulationsumgebung

In Bearbeitung:

Ansprechpartner

© Sven Ellger

© Sven Ellger

Wissenschaftlicher Mitarbeiter

NameDr.-Ing. Hannes Braßel

Eine verschlüsselte E-Mail über das SecureMail-Portal versenden (nur für TUD-externe Personen).

Professur für Technologie und Logistik des Luftverkehrs

Besuchsadresse:

Gerhart-Potthoff-Bau (POT), Raum 166 Hettnerstraße 1-3

01069 Dresden